Что принесет европейскому рынку EU AI Act?

2024-09-24

De Novo Cloud Expert

Не так давно на территории Европейского Союза вступил в силу в силу EU AI Act — первый в истории всеобъемлющий регламент, направленный на регулирование в области искусственного интеллекта. Каковы его особенности и на какие сферы он может повлиять в будущем?

Растущее влияние искусственного интеллекта, которое в последние годы отмечается во всем мире, всерьез беспокоит правительства многих стран. Никто не хочет оказаться в ситуации, когда AI/ML технологии выйдут из-под контроля и станут угрозой для национальной безопасности. И речь идет вовсе не о «восстании машин», гораздо раньше искусственный интеллект могут поставить себе на службу, например, преступники и террористы всех мастей (тенденции к этому уже прослеживаются). Чтобы предупредить будущие угрозы, сегмент ИИ нуждается в четком регулировании. Так решили в Европейском Союзе, приняв EU AI Act — первый в мире надгосударственный регламент (комплекс законов и правил) об искусственном интеллекте.

Контроль на основе рисков

Основная цель регламента состоит в том, чтобы сделать системы искусственного интеллекта, используемые в ЕС, безопасными, прозрачными, контролируемыми, недискриминационными и экологически нейтральными. Один из главных принципов гласит:

«Во избежание опасных последствий, контроль над системами искусственного интеллекта должны осуществлять люди, а не автоматизированные системы»

Действие регламента распространяется на всех разработчиков, дистрибьюторов, интеграторов, операторов услуг, а также другие компании и организации, занятые в сфере искусственного интеллекта — как в ЕС, так и за его пределами (если результаты деятельности предназначены для использования в странах Евросоюза).

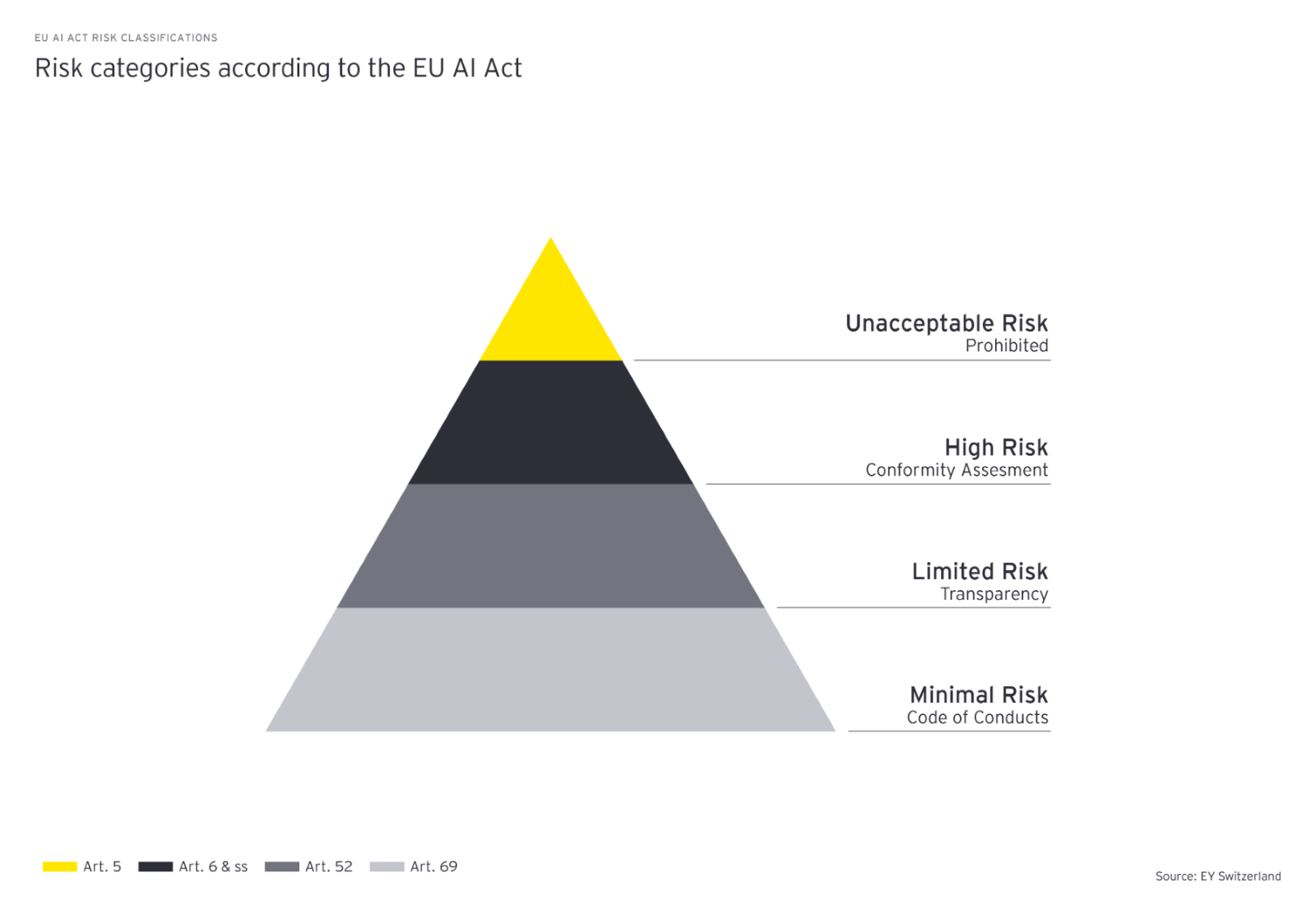

Обязательства участников рынка будут зависеть от уровня «риска» со стороны искусственного интеллекта (всего определено четыре категории) при этом большая часть ответственности ляжет на разработчиков ИИ, отнесенных к категории «высокого риска».

На вершине пирамиды — «неприемлемый риск», системы этой группы будут почти полностью запрещены. Их можно будет использовать только в работе правоохранительных органов и только лишь в области биометрической идентификации.

К группе решений, представляющих «неприемлемый риск» EU AI Act относит:

- Решения для когнитивно-поведенческого манипулирования людьми или конкретными уязвимыми группами: например, активируемые голосом игрушки, которые поощряют опасное поведение у детей.

- Все виды систем для формирования социальных рейтингов: классификация людей на основе поведения, социально-экономического статуса или личных характеристик.

- Системы биометрической идентификации и категоризация людей — например распознавание лиц — как в реальном времени, так и постфактум (за исключением решений для правоохранительных органов).

- Инструменты оценки риска совершения лицом уголовных преступлений исключительно на основе профиля или личностных качеств.

- Решения для выявления эмоций на рабочих местах или в учебных заведениях , за исключением медицинских соображений или систем безопасности.

В регламенте отмечается, что системы искусственного интеллекта, которые негативно влияют на безопасность или основные права, будут отнесены к категории «высокого риска» и их разделят на две категории. Первая включает в себя системы, которые работают в жестко регулируемых отраслях, таких как авиация, автомобили, медицинские устройства, лифты и пр.

Вторая категория охватывает конкретные сферы применения ИИ, в числе которых:

- Управление критической инфраструктурой и ее эксплуатация

- Образование и профессиональная подготовка

- Трудовая занятость и управление персоналом

- Основные частные сервисы, государственные услугами и управление льготами

- Работа правоохранительных органов

- Управление миграцией и пограничным контролем

- Помощь в юридическом толковании и применении закона

Продукты второй группы будут оцениваться перед выпуском на рынок, а также на протяжении всего жизненного цикла. Также, в соответствии с регламентом люди будут иметь право подавать жалобы на системы искусственного интеллекта в назначенные национальные органы.

Кстати, чат-боты на основе больших языковых моделей (LLM) не стали относить к категории высокого риска, но такие решения должны будут соответствовать требованиям прозрачности и Закону ЕС об авторском праве. Помимо этого, системы ИИ, классифицированные как представляющие минимальный риск, должны будут соответствовать общеевропейскому кодексу поведения.

Весь мир с интересном наблюдает

Штрафы за несоблюдение положений регламента очень существенны и варьируются в пределах от 7,5 до 35 миллионов евро, либо от 1% до 7% годового оборота компании, в зависимости от серьезности нарушения. В то же время, предусмотрен переходный период для приведения решений в соответствие новым требованиям — полгода для запрещенных типов систем, год для ИИ общего назначения (GPAI) и два года для достижения полного соответствия законодательству всеми участниками рынка.

Поскольку EU AI Act не имеет аналогов в мире, а его основные положения пока только начали вступать в силу (на полную силу регламент заработает летом 2026 года), эксперты не могут сойтись во мнении, насколько эффективным может стать его применение. Главные опасения касаются того, что регламент может затормозить в ЕС быстро развивающийся рынок AI/ML-решений. С другой стороны, важность контроля и безопасности в вопросах ИИ никто не отвергает. Похоже, главной трудностью здесь будет нахождение баланса между ограничениями и защитой — если его удастся достигнуть, опыт Евросоюза без сомнения станет основой соответствующего законодательства во многих других странах. Например, уже сейчас активное обсуждение EU AI Act идет в законодательных органах Великобритании и экспертном сообществе США.

Краткое изложение основных положений EU AI Act можно найти на официальной странице документа. Так же там есть краткие пояснения к основным положениям регламента и дополнительная информация по вопросам использования ИИ в Евросоюзе.