Що принесе європейському ринку EU AI Act?

2024-09-24

De Novo Cloud Expert

Нещодавно на території Європейського Союзу набув чинності EU AI Act — перший в історії всеосяжний регламент, спрямований на регулювання у галузі штучного інтелекту. Які його особливості та на які напрямки він може здійснити найбільший вплив у майбутньому?

Зростання впливу штучного інтелекту, що останніми роками відбувається по усьому світі, непокоїть уряди багатьох країн. Ніхто не хоче опинитися в ситуації, коли технології AI/ML вийдуть з-під контролю та стануть загрозою для національної безпеки. Адже йдеться зовсім не про «повстання машин», набагато раніше штучний інтелект можуть поставити собі на службу, наприклад, злочинці та навіть терористи (тенденції до цього вже простежуються). Щоб запобігти майбутнім загрозам, сегмент ШІ потребує чіткого регулювання. Так вирішили в Європейському Союзі, ухваливши EU AI Act — перший у світі наддержавний регламент (комплекс законів та правил) про штучний інтелект.

Контроль на основі ризиків

Основна мета регламенту полягає в тому, щоб зробити системи штучного інтелекту, які використовуються в ЄС, безпечними, прозорими, контрольованими, недискримінаційними та екологічно нейтральними. Один із головних принципів документу стверджує:

«Щоб уникнути небезпечних наслідків, контроль над системами штучного інтелекту повинні здійснювати люди, а не автоматизовані системи»

Дія регламенту поширюється на всіх розробників, дистриб'юторів, інтеграторів, операторів послуг, а також інші компанії та організації, що зайняті у галузі штучного інтелекту — як у ЄС, так й за його межами (якщо результати діяльності призначені для використання у країнах Євросоюзу).

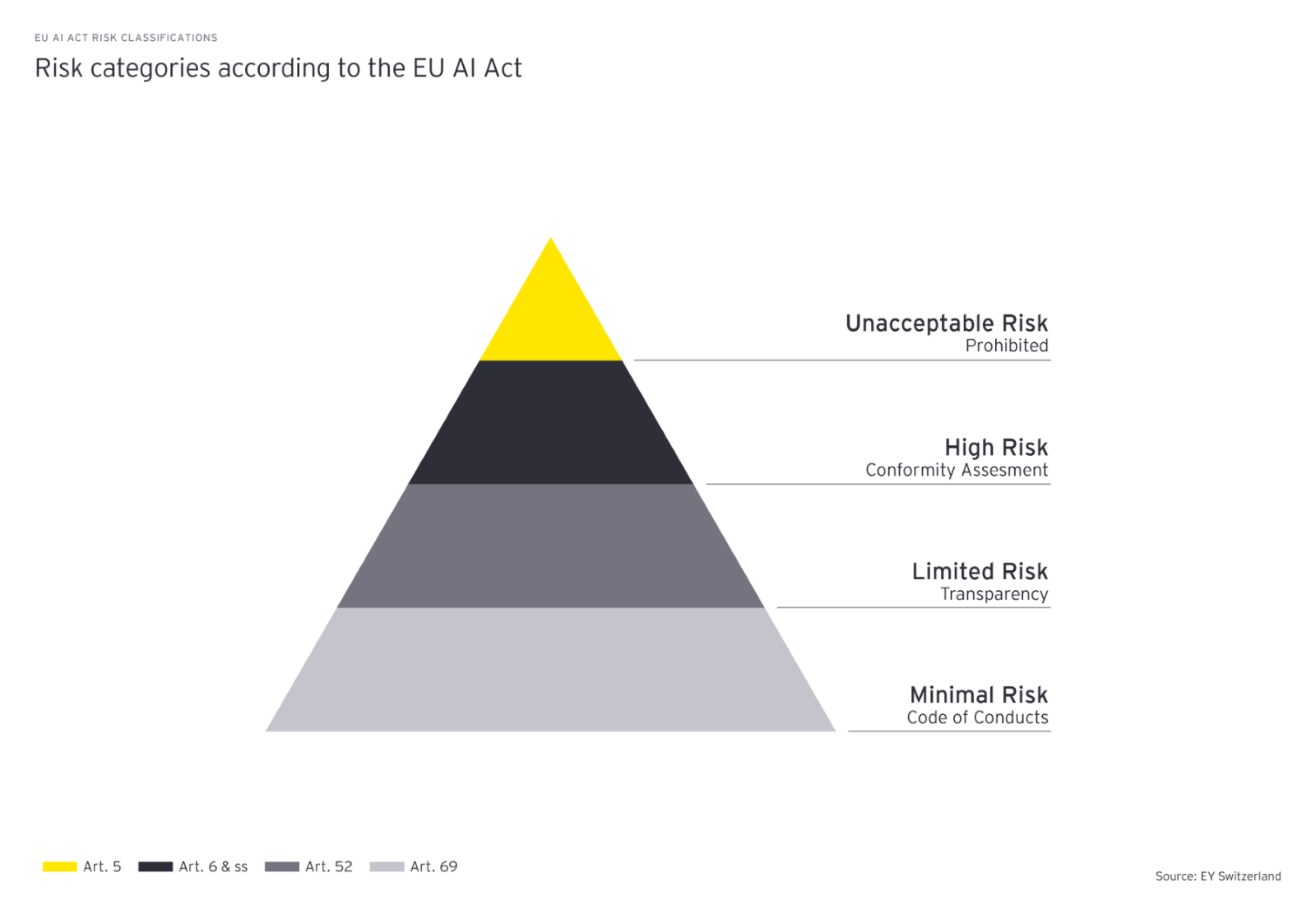

Зобов'язання учасників ринку залежатимуть від рівня «ризику» з боку систем штучного інтелекту (визначено чотири категорії), при цьому більша частина відповідальності ляже на розробників ШІ, віднесених до категорії «високого ризику».

На вершині піраміди — «неприйнятний ризик», системи цієї групи майже повністю заборонені. Їх можна буде використовувати лише в роботі правоохоронних органів й тільки для біометричної ідентифікації.

До групи рішень, що становлять «неприйнятний ризик», EU AI Act відносить:

- Рішення для когнітивно-поведінкового маніпулювання людьми або конкретними вразливими групами: наприклад, іграшки, що активуються голосом, що заохочують небезпечну поведінку у дітей.

- Усі види систем формування соціальних рейтингів: класифікація людей з урахуванням поведінки, соціально-економічного статусу чи особистих характеристик.

- Системи біометричної ідентифікації та категоризація людей — наприклад, розпізнавання осіб — як у реальному часі, так й постфактум (за винятком рішень для правоохоронних органів).

- Інструменти оцінки ризику вчинення особою кримінальних злочинів виключно на основі профілю або особистісних якостей.

- Рішення для виявлення емоцій на робочих місцях чи навчальних закладах, окрім медичних міркувань чи систем безпеки.

У регламенті наголошується, що системи штучного інтелекту, що негативно впливають на безпеку чи основні права, будуть віднесені до категорії «високого ризику», до того ж їх поділять на дві категорії. Перша включає системи, які працюють у жорстко регульованих галузях, таких як авіація, автомобілі, медичні пристрої, ліфти та ін.

Друга категорія охоплює конкретні сфери застосування ШІ, серед яких:

- Управління критичною інфраструктурою та її експлуатація

- Освіта та професійна підготовка

- Трудова зайнятість та управління персоналом

- Основні приватні сервіси, державні послуги та управління пільгами

- Робота правоохоронних органів

- Управління міграцією та прикордонним контролем

- Допомога в юридичному тлумаченні та застосуванні закону

Продукти другої групи оцінюватимуться перед випуском на ринок, а також протягом усього життєвого циклу. Також, відповідно до регламенту, люди матимуть право подавати скарги на системи штучного інтелекту до відповідних національних органів.

До речі, чат-боти на основі великих мовних моделей (LLM) не стали відносити до категорії високого ризику, але такі рішення повинні відповідати вимогам прозорості та Закону ЄС про авторське право. Крім цього, системи ШІ, класифіковані як такі, що становлять мінімальний ризик, повинні будуть відповідати загальноєвропейському кодексу поведінки.

Весь світ спостерігає

Штрафи за недотримання положень регламенту дуже суттєві та становлять від 7,5 до 35 мільйонів євро, або від 1% до 7% річного обороту підприємства, залежно від важкості порушення. Водночас передбачено перехідний період для приведення рішень у відповідність до нових вимог — півроку для заборонених типів систем, рік для ШІ загального призначення (GPAI) та два роки для досягнення повної відповідності законодавству всіма учасниками ринку.

Оскільки EU AI Act не має аналогів у світі, а його основні положення поки що лише почали набирати чинності (на повну силу регламент запрацює влітку 2026 року), експерти не можуть зійтись у тому, наскільки ефективним може стати його застосування. Головні побоювання стосуються того, що регламент може загальмувати в ЄС ринок AI/ML-рішень, що наразі швидко розвивається. З іншого боку, важливість контролю та безпеки у питаннях ШІ ніхто не відкидає. Схоже, головною складністю тут буде знаходження балансу між обмеженнями та захистом — якщо його вдасться досягти, досвід Євросоюзу, без сумніву, стане основою відповідного законодавства у багатьох інших країнах. Наприклад, вже зараз активне обговорення EU AI Act відбувається у законодавчих органах Великобританії та експертній спільноті США.

Короткий виклад основних положень EU AI Act можна знайти на офіційній сторінці документа. Також там є короткі пояснення щодо основних положень регламенту та додаткова інформація стосовно використання ШІ в Євросоюзі.