Как NVIDIA AI Enterprise меняет правила игры в AI и ML

2025-04-29

NVIDIA AI Enterprise — это корпоративная платформа для полного цикла работы с AI/ML-нагрузками. Она объединяет оптимизированные библиотеки, инструменты и сервисы, чтобы обеспечить масштабируемость, стабильность и поддержку. Давайте рассмотрим архитектуру, функции и преимущества платформы, а также пошаговый подход к внедрению.

Искусственный интеллект становится критически важным ресурсом в цифровой экономике. Компании стремятся внедрять решения на базе ИИ для повышения операционной эффективности, автоматизации процессов и получения конкурентных преимуществ. Внедрение AI-технологий, особенно в сложных инфраструктурах, часто сталкивается с проблемами совместимости, непрерывности и поддержки. Именно эти факторы стали точкой входа для NVIDIA AI Enterprise — интегрированной платформы, которая упрощает путь к созданию, развёртыванию и сопровождению AI/ML-решений. Это современный инструмент для проектов любой сложности — от пилотных POC до масштабных внедрений.

Обзор NVIDIA AI Enterprise

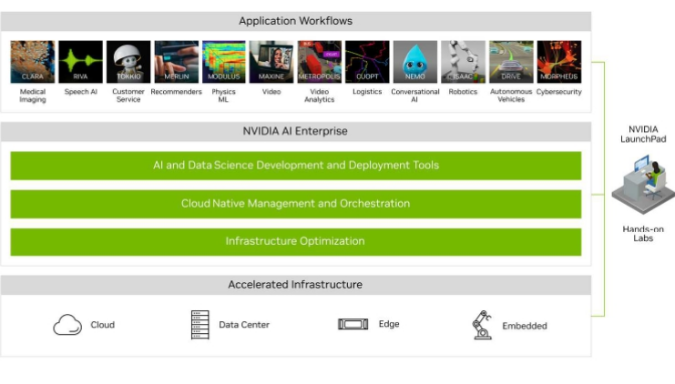

NVIDIA AI Enterprise — это коммерческая платформа с поддержкой корпоративного уровня, которая позволяет компаниям создавать, развёртывать и управлять AI/ML-нагрузками на инфраструктурах любой сложности — от локальных дата-центров до облаков. Она разработана с фокусом на стабильность, безопасность, масштабируемость и оптимизацию ресурсов. Платформа интегрирует более 50 фреймворков, библиотек и решений NVIDIA, ускоряя инновации в области компьютерного зрения, обработки естественного языка, генеративного ИИ и глубинного обучения.

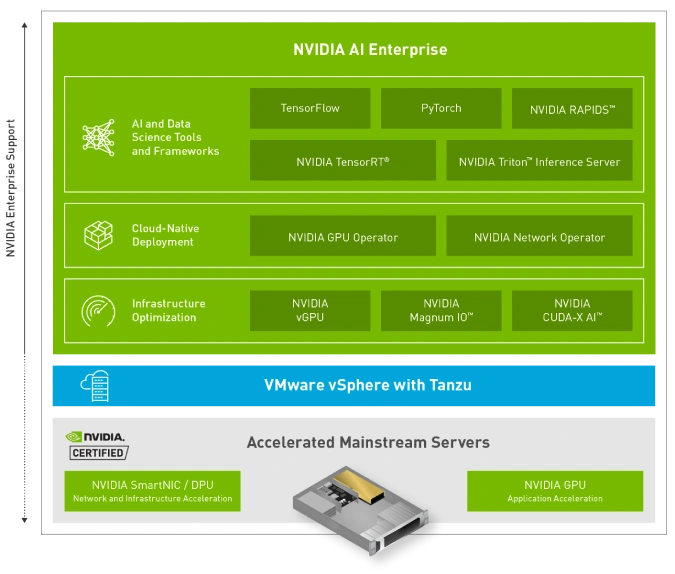

Среди её компонентов — драйверы NVIDIA для GPU, оптимизированные среды выполнения (например, TensorRT или Triton Inference Server), инструменты для работы с контейнерами (NVIDIA Container Toolkit), библиотеки RAPIDS для обработки данных, а также многочисленные примеры и SDK. Этот набор позволяет компаниям существенно снизить стоимость разработки и сократить время вывода продукта на рынок. Благодаря интеграции с платформами вроде VMware vSphere, Red Hat OpenShift и облаками AWS, Azure, Google Cloud, AI Enterprise обеспечивает бесперебойную работу в гибридных и мультиоблачных сценариях.

NVIDIA AI Enterprise активно развивается как стратегическая часть корпоративной экосистемы NVIDIA, предлагая поддержку не только технологий, но и технической документации, обновлений безопасности, регулярных релизов и специализированной поддержки. Это делает платформу привлекательной для команд в сферах здравоохранения, финансов, ритейла, логистики и производства, где надёжность и производительность AI-решений имеют первостепенное значение.

Что такое NVIDIA AI Enterprise?

С технической точки зрения, NVIDIA AI Enterprise — это лицензированный программный стек, предоставляющий доступ к набору ПО, оптимизированного для использования с GPU NVIDIA в виртуализированных средах. В его основе — поддержка фреймворков TensorFlow, PyTorch, XGBoost, RAPIDS, а также предсобранные контейнеры из Docker-репозитория NVIDIA NGC (NVIDIA GPU Cloud). Это позволяет разработчикам и дата-сайентистам запускать задачи обучения, инференса и анализа данных быстрее и стабильнее, без сложной настройки окружения.

Ключевым элементом является интеграция с корпоративными средами, в частности, с виртуализационной платформой VMware. Благодаря сертификации VMware vSphere с NVIDIA vGPU можно разворачивать несколько изолированных AI-инстансов на одном физическом GPU, что значительно повышает эффективность использования ресурсов. Другие поддерживаемые среды Nvidia AI cloud включают Red Hat OpenShift, SUSE Rancher, Ubuntu, а также облака Amazon EC2 G5, Azure NC, GCP A2.

Помимо самих компонентов, AI Enterprise включает обслуживание критически важных для бизнеса функций: техподдержку на уровне SLA, обновления безопасности, патчи, а также стабильные версии сред для продуктивной эксплуатации. Это не просто набор библиотек, а полноценная платформа, позволяющая трансформировать AI-разработку в управляемый бизнес-процесс.

Как работает NVIDIA AI Enterprise?

NVIDIA AI Enterprise функционирует как многоуровневый технологический стек, охватывающий все этапы жизненного цикла AI/ML — от подготовки данных до развёртывания моделей в продуктивной среде. Основу платформы составляют драйверы GPU, обеспечивающие низкоуровневое взаимодействие с аппаратным обеспечением. Поверх этого слоя работают библиотеки CUDA, cuDNN и другие вычислительные среды, позволяющие эффективно использовать ресурсы NVIDIA для обучения и инференса моделей.

Инструменты для управления окружением включают NVIDIA Docker Runtime, поддержку Kubernetes с GPU-оператором, интеграцию с Red Hat OpenShift и Helm-чарты для быстрого развёртывания компонентов. Компоненты, такие как Triton Inference Server, позволяют выполнять высокопроизводительный инференс с поддержкой нескольких фреймворков одновременно, а также динамическое масштабирование нагрузки. Инструмент Triton поддерживает такие функции, как A/B-тестирование моделей, маршрутизация запросов и мониторинг производительности с помощью Prometheus и Grafana.

Для обучения моделей NVIDIA AI Enterprise предлагает интеграцию с NGC Workspaces — средами разработки с преднастроенными окружениями, где возможно запускать Jupyter Notebook, обучать модели в облачной (Nvidia cloud AI) или локальной инфраструктуре, выполнять гиперпараметрическую оптимизацию и эксперименты. При запуске рабочих нагрузок в виртуализированных средах, таких как VMware, можно эффективно распределять ресурсы GPU, что делает платформу подходящей даже для организаций с ограниченным аппаратным фондом.

Обзор компонентов и функций NVIDIA AI Enterprise

Архитектура NVIDIA AI Enterprise построена вокруг принципа модульности и оптимизации для продуктивной среды. Среди основных компонентов платформы Nvidia AI стоит выделить NVIDIA CUDA Toolkit — базовую платформу для параллельных вычислений, обеспечивающую доступ к вычислительным возможностям GPU. Другие важные элементы включают cuDNN (глубокое обучение), NCCL (сетевой интерфейс для распределённых вычислений), DALI (препроцессинг изображений), а также RAPIDS — набор библиотек для работы с данными в стиле pandas, но с аппаратным ускорением.

В сегменте инференса платформу дополняет Triton Inference Server — мощный сервис, способный обрабатывать модели, созданные в TensorFlow, PyTorch, ONNX, XGBoost и других. Его функционал позволяет обрабатывать запросы в режиме реального времени, поддерживает динамическую загрузку моделей, а также оптимизацию вычислений с помощью TensorRT. Благодаря этому инструменту возможно достичь минимальной задержки ответа при высокой нагрузке без потери точности моделей.

Для автоматизации развёртывания NVIDIA предлагает Helm-чарты и GPU Operator, которые позволяют быстро и надёжно инсталлировать все необходимые компоненты в Kubernetes-среде. Кроме того, пользователи могут воспользоваться готовыми Docker-образами из NVIDIA NGC, которые проходят регулярное тестирование на совместимость и производительность. Это значительно упрощает процессы CI/CD, обеспечивает воспроизводимость окружений и снижает риски, связанные с обновлениями.

В области обработки естественного языка и компьютерного зрения NVIDIA AI Enterprise включает в себя предварительно обученные модели и SDK, в частности TAO Toolkit для трансферного обучения, NeMo для работы с языковыми моделями и DeepStream для видеоаналитики. Эти инструменты ориентированы как на исследователей, так и на инженеров, стремящихся интегрировать AI в свои приложения без необходимости писать код с нуля. Модели могут быть кастомизированы под конкретные бизнес-задачи и легко адаптируются к новым датасетам.

Платформа также предусматривает интеграцию с ведущими системами мониторинга и логирования — Prometheus, Grafana, Fluentd, что позволяет организациям наладить полный цикл наблюдения за производительностью моделей и всей AI-инфраструктуры. Это критически важно для соблюдения SLA и соответствия требованиям безопасности.

Какие преимущества даёт NVIDIA AI Enterprise для AI и ML?

Одним из ключевых преимуществ NVIDIA AI Enterprise является её способность уменьшить техническую сложность внедрения искусственного интеллекта. Благодаря предварительно протестированным компонентам и сертифицированной инфраструктуре, эта платформа позволяет существенно снизить затраты на внедрение и ускорить получение результатов. Организации получают доступ к инструментам, которые работают «из коробки», и могут начать эксперименты с AI-проектами без глубоких знаний DevOps или GPU-инфраструктуры.

Для команд разработчиков и исследователей большое значение имеет стабильность среды. NVIDIA AI Enterprise обеспечивает воспроизводимость результатов, контроль версий, поддержку совместимости компонентов и предсказуемость производительности. Это делает её удобной платформой как для этапа R&D, так и для масштабного продуктивного развёртывания. Важно также, что NVIDIA предоставляет поддержку на уровне SLA, что критично для организаций с высокими требованиями к непрерывности работы сервисов.

Ещё одно важное преимущество — масштабируемость AI Nvidia. Платформа одинаково хорошо подходит как для небольших AI-проектов на одной машине, так и для распределённых задач на кластере GPU-серверов. Это позволяет начать с малого, а затем расширять ресурсы без необходимости менять стек. Интеграция с VMware, Kubernetes и облаками даёт гибкость, необходимую для современной AI-инфраструктуры.

Наконец, важным преимуществом является доступ к экосистеме NVIDIA NGC: тысячи оптимизированных моделей, примеров, инструментов и гайдов. Это не только ускоряет запуск, но и позволяет учиться на примерах, масштабировать знания команды и использовать лучшие практики отрасли.

Как начать работу с NVIDIA AI Enterprise?

Первый шаг — определить тип инфраструктуры, которую планируется использовать: локальная, виртуализированная или облачная. NVIDIA Enterprise AI поддерживает работу как на bare-metal серверах, так и в виртуализированных средах (VMware vSphere, Red Hat OpenShift), а также в публичных облаках. Выбор среды влияет на метод развёртывания: в случае Kubernetes — через Helm-чарты; в VMware — через vSphere Plugin или vGPU-профили.

Следующий этап — оформление лицензии NVIDIA AI Enterprise, что открывает доступ к сертифицированным сборкам, документации, сервисам поддержки и регулярным обновлениям. Продукт можно приобрести через авторизованных партнёров или напрямую у NVIDIA. Рекомендуется также воспользоваться порталом NVIDIA LaunchPad — бесплатной тестовой средой, где можно ознакомиться с возможностями платформы в формате live demo.

Развёртывание обычно начинается с установки драйверов, CUDA и необходимых библиотек. После этого — интеграция с системами мониторинга, подготовка среды CI/CD и инструментов для разработчиков (NGC CLI, JupyterHub, MLflow). Опционально можно настроить механизмы распределения нагрузки, тестирования производительности и автоматического масштабирования моделей в Triton Server.

После завершения базовой настройки команды могут приступить к обучению собственных моделей или адаптировать готовые из каталога NGC. При необходимости поддержки — доступны консультации NVIDIA и сообщество пользователей. Таким образом, AI Enterprise — это платформа, которая не только упрощает запуск, но и обеспечивает полный жизненный цикл AI-решений — от идеи до внедрения. Компании могут быстро пройти путь от исследовательского прототипа до масштабируемой продуктивной системы с минимальными рисками и затратами на поддержку. Благодаря чёткому позиционированию в экосистеме корпоративного ИИ платформа становится надёжной основой для цифровых трансформаций и долгосрочного развития бизнеса.

Выводы

NVIDIA AI Enterprise — это не просто технологический продукт, а стратегический инструмент для ускорения внедрения искусственного интеллекта в бизнес-процессы. Благодаря гибкой архитектуре, широкой поддержке фреймворков, сертификации для ведущих платформ виртуализации и облаков, она существенно снижает барьер входа в AI и позволяет сосредоточиться на создании ценности, а не на инфраструктурных проблемах. Для компаний, стремящихся быть на передовой технологического развития, NVIDIA AI Enterprise предлагает стабильность, масштабируемость и полноценную поддержку на каждом этапе. Это решение идеально подходит для команд, ценящих контроль, производительность и долгосрочную надёжность в сфере искусственного интеллекта.