De Novo AI Studio — a quick start into the world of generative AI

AI Studio is a ready-made environment where you can create your own applications with generative AI, test them, and safely connect them to business processes. The platform is suitable for both development teams and specialists without in-depth technical knowledge, as it supports a low-code/no-code approach, i.e., creating solutions without programming or with minimal code.

De Novo AI Studio is a Ukrainian platform for working with generative artificial intelligence, built on the De Novo Tensor Cloud. It helps companies quickly launch and develop AI solutions — without complex configurations and technical barriers. Whereas previously it could take weeks to implement an AI model, with AI Studio the process takes just a few hours.

The platform is based on a convenient system for managing models, monitoring their performance, and analytics. You can choose how the AI will process requests, track performance, and flexibly manage resources. All this takes place in an isolated and secure environment that meets the highest compliance and data protection requirements.

In other words, De Novo AI Studio is a workspace for generative AI that takes care of the technical side, leaving you to focus on what matters most — creating value for your business.

Advantages of De Novo AI Studio

Ready to use

AI Studio is available in the form of templates with interconnected virtual machines that can be deployed in the De Novo Tensor Cloud within a few dozen minutes.

After deployment, the user receives a fully ready environment with integrated services, authentication, monitoring, and backup — all in Ukraine.

Security and sovereignty

AI Studio operates in a Ukrainian cloud certified according to ISO 27001, PCI DSS, and KSZI. Data and models are stored in secure segments with full access control.

The platform allows you to implement AI projects for businesses under Ukrainian jurisdiction, with full control over the infrastructure and transparent pricing and flexible deployment rates.

Who is it designed for?

Get a complete environment for researching, testing, and launching GenAI models. Experiment with LLM, configure pipelines, and integrate results into your own services.

Deploy GenAI solutions in a secure, controlled environment with powerful GPUs. Implement AI solutions without the risk of data leaks or dependence on cloud providers

AI Studio simplifies the creation of custom solutions — from chatbots to document analysis systems — using ready-made components and low-code/no-code tools

Launch your own AI product in literally a day. Get a full stack of tools for rapid prototyping, scaling, and further deployment in the cloud

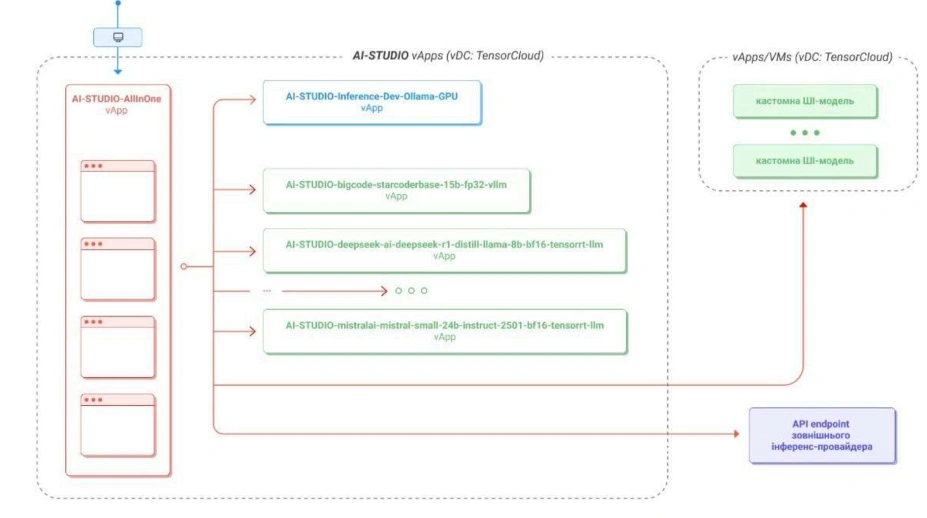

Architecture and components

The AI Studio platform is built on a modular principle and combines proven open-source tools that together form a complete environment for GenAI — from data collection to monitoring and automation.

Monitoring and observability

Components such as Beszel, Glances, and Dozzle provide control over system performance—they collect metrics from containers and servers, display historical data, allow real-time log tracking, and quickly diagnose failures.

AI application development and orchestration

Dify combines Backend-as-a-Service with LLMOps, simplifying the creation of generative applications even without programming.

Langfuse helps teams analyze model performance, debug responses, and improve LLM performance.

LiteLLM acts as a universal gateway that supports over a hundred LLM APIs (OpenAI, Anthropic, Azure, Bedrock, Vertex AI, Hugging Face, etc.), providing flexibility and standardization of calls.

Inference and interaction with models

Ollama and Open WebUI create a secure environment for running large language models locally with support for GPUs, caching, RAG, and modern interfaces.

Lobe Chat adds a user frontend for AI chats, supporting multiple model providers (OpenAI, Claude, Gemini, DeepSeek, Qwen, Ollama) and the ability to connect custom knowledge bases.

Data processing and enrichment

Docling unifies document handling—from PDF and Word to audio and HTML—by converting them into structured data suitable for LLM.

Firecrawl automatically converts web pages into clean, structured datasets ready for analytics or model training.

Perplexica performs intelligent real-time search, combining machine learning capabilities with open web search.

SearXNG aggregates results from over 250 sources, providing private and accurate search without user tracking.

Integration and automation

n8n combines AI components with company business processes, automating tasks from data preparation to communication between services.

Portainer simplifies container management in Docker, Swarm, and Kubernetes, enabling rapid deployment and scaling of AI Studio infrastructure.

Try AI Studio today

De Novo AI Studio in Tensor Cloud is the fastest way to go from idea to working GenAI solution in Ukraine. Contact the De Novo team to get a demo, consultation, or deploy your own project within a day — experience how a new generation AI tool makes automation with AI Studio simple, fast, and more secure.

Компоненти AI Studio

Легка та ефективна платформа моніторингу серверів, яка забезпечує повний контроль за системними ресурсами. Beszel збирає статистику Docker, надає історичні дані, підтримує багатокористувацький режим, резервне копіювання та автентифікацію через OAuth. Простий веб-інтерфейс і готовність «з коробки» роблять її зручним рішенням для безперервного моніторингу інфраструктури.

Відкрита платформа для створення AI-застосунків, що поєднує Backend-as-a-Service і LLMOps. Dify спрощує побудову генеративних рішень, дозволяючи як розробникам, так і аналітикам без технічного досвіду створювати власні AI-інструменти. Глибока інтеграція з API та готові блоки автоматизації роблять її основою швидкої AI-розробки.

Інструмент для уніфікованої обробки документів, який перетворює PDF, DOCX, XLSX, PPTX, HTML, WAV, MP3 і VTT у структуровані дані. Зберігає форматування, таблиці та структуру документів, що робить його незамінним для підготовки даних у генеративних моделях. Docling інтегрується з LLM для точного аналізу корпоративних документів.

Легкий веб-застосунок для моніторингу логів у реальному часі. Дозволяє переглядати, фільтрувати та шукати журнали контейнерів без складного налаштування. Завдяки простому інтерфейсу Dozzle підходить для DevOps-команд, які потребують миттєвого доступу до логів без додаткових інструментів

Інтелектуальний інструмент веб-скрейпінгу, який автоматично перетворює сайти на структуровані дані. Може працювати як API-сервіс або як самостійний сервер, підтримує формати Markdown, JSON і текст. Завдяки Firecrawl команди отримують чисті датасети для тренування або тестування моделей.

Кросплатформна система моніторингу, яка надає максимум інформації про ресурси через веб-інтерфейс. Автоматично адаптує відображення даних під розмір терміналу, надаючи єдину панель спостереження. Завдяки цьому Glances є ефективним інструментом у складі AI Studio для візуалізації навантаження систем.

Відкрита платформа інженерії LLM, що допомагає відлагоджувати, аналізувати та вдосконалювати AI-застосунки. Langfuse збирає телеметрію викликів моделей і дозволяє командам контролювати якість відповідей. Усі функції інтегровані нативно для прискорення розробки та розгортання LLM-рішень.

Універсальний проксі-сервер та Python SDK для виклику понад сотні API у форматі OpenAI. Рішення забезпечує єдиний стандарт взаємодії з різними LLM — Bedrock, Azure, Vertex AI, Hugging Face, Anthropic, Cohere тощо. Завдяки LiteLLM розробники можуть швидко інтегрувати кілька моделей у межах одного проєкту.

Відкритий фреймворк для побудови чатів зі штучним інтелектом. Підтримує OpenAI, Claude, Gemini, DeepSeek, Qwen і Ollama, а також бази знань і RAG. За допомогою Lobe Chat можна створювати AI-чатботів із сучасним інтерфейсом і можливістю інтеграції корпоративних даних.

Гнучкий інструмент автоматизації, який поєднує автоматизацію бізнес-процесів і можливості ШІ. Дозволяє створювати ланцюжки обробки даних, інтегрувати моделі з внутрішніми системами та підвищувати ефективність робочих процесів. Завдяки n8n, AI Studio стає універсальною платформою для бізнес-автоматизації.

Локальний інференс-двигун (inference engine) для запуску великих мовних моделей (LLM) у приватному середовищі. Рішення підтримує GPU, кешування й інтеграцію через OpenAI-сумісний API. Завдяки Ollama, компанії можуть безпечно запускати власні LLM без підключення до зовнішніх хмар.

Розширювана платформа для самостійного хостингу моделей. Підтримує запуск LLM через Ollama або OpenAI API та має вбудовані механізми RAG. Завдяки Open WebUI користувачі отримують автономне середовище для побудови й тестування AI-застосунків.

Пошукова платформа (search engine) нового покоління, що працює на базі ШІ. Вона поєднує інтернет-пошук у реальному часі з генеративними алгоритмами для точних відповідей із цитуванням джерел. Використовуючи Perplexica, користувачі отримують релевантні результати замість звичайного пошуку за ключовими словами.

Потужна система управління контейнерами з відкритим кодом. Дозволяє створювати, масштабувати та контролювати середовища Docker, Swarm і Kubernetes. Завдяки Portainer, адміністратори можуть централізовано керувати контейнерною інфраструктурою AI Studio.

Метапошукова система, яка агрегує результати з понад 250 пошукових сервісів. Разом з тим гарантує приватність користувачів та не відстежує їхню активність. У складі AI Studio SearXNG використовується як безпечний інструмент для збору даних і аналітики в закритих середовищах.